之前给大家分享的很多教程都是通过客户端或者工具调用DeepSeek API,早期也分享了使用Ollama实现在电脑本地离线部署大模型的教程,感兴趣的小伙伴可以看一下: https://www.mkeai.com/tutorials/detail/30.html

Ollama支持市面上所有的开源大模型本地部署,非常方便,并且集成好openai api通用格式,直接调用就可以在任何工具中使用。

今天要给大家分享的是利用手机来离线部署DeepSeek大模型(同样是所有开源大模型都支持,自己选择性下载不同的模型即可),实现在手机上离线使用AI,确保绝对的安全性。

当然这次也要利用一个软件【PocketPal AI】,这是一个开源软件,所以不用担心病毒啥的,开源地址是: https://github.com/a-ghorbani/pocketpal-ai

github国内可能需要魔法上网才能正常访问,所以我已经将安卓的安装包打包好了,直接进网盘下载:

安卓: https://pan.quark.cn/s/3067657fb27a

ios: https://apps.apple.com/cn/app/id6502579498

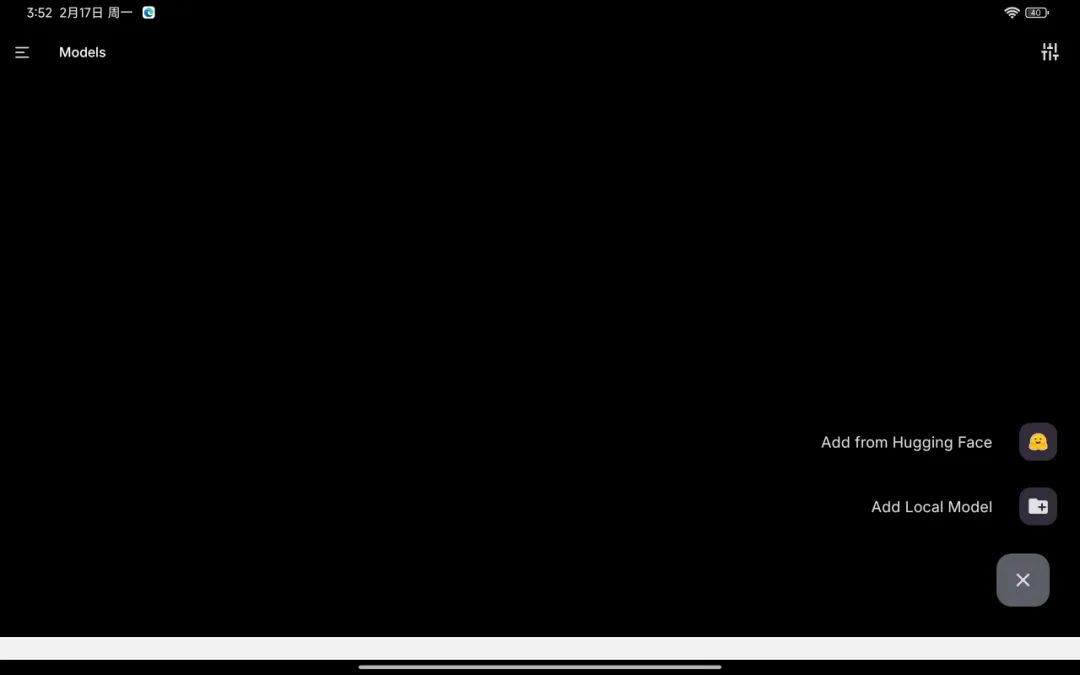

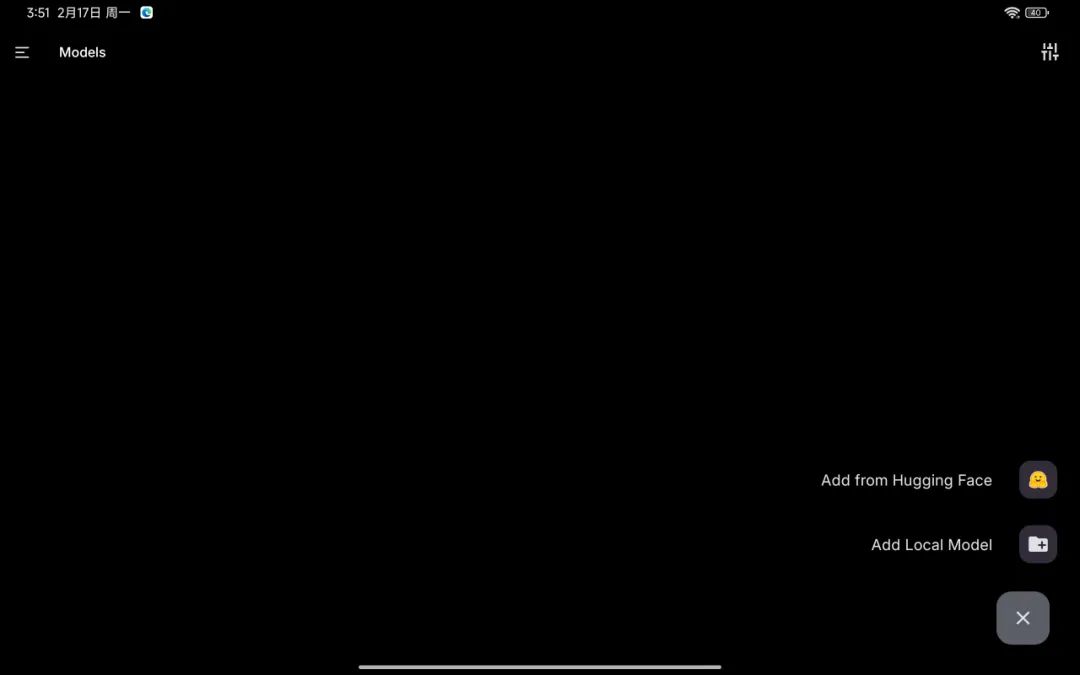

手机上安装好PocketPal AI软件后,打开软件,第一步需要先下载模型,点击 + 添加模型,Add from Hugging Face 进行下载。

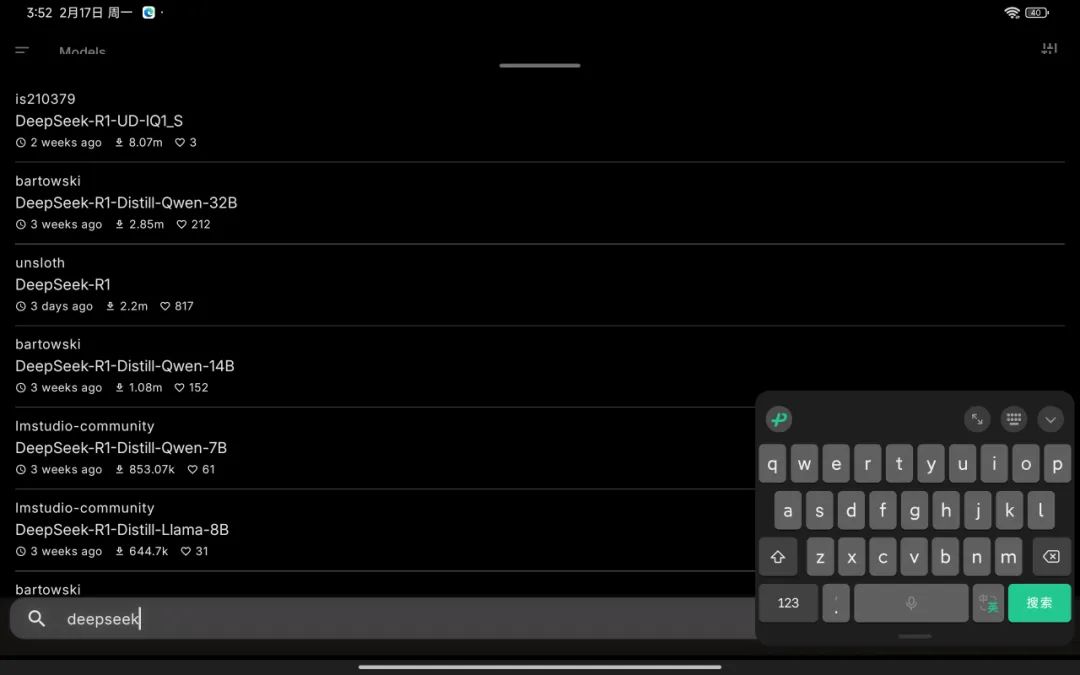

进入开源模型列表中,直接搜索DeepSeek,选择你需要的版本进行下载,手机上的话,一般只能运行1.5B或者7B版本,更大规模的手机带不动。

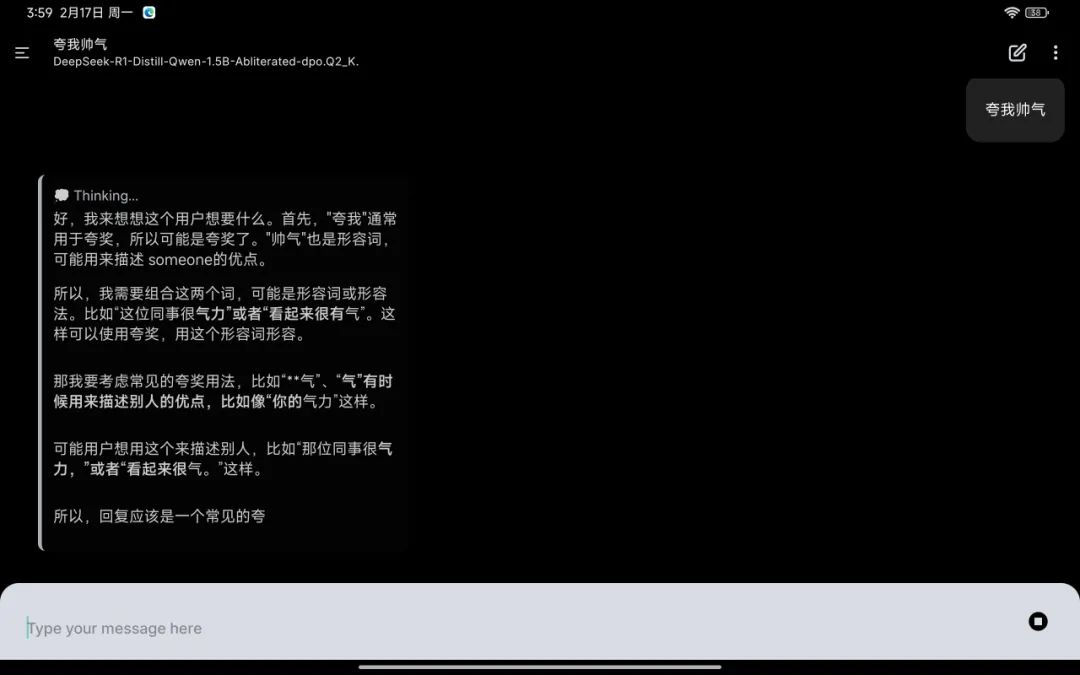

等待DeepSeek模型下载好了之后,在模型管理里面,点击 Load 启动。然后就可以使用离线版本 DeepSeek 了。我们测试一下,已经可以正常输出了。

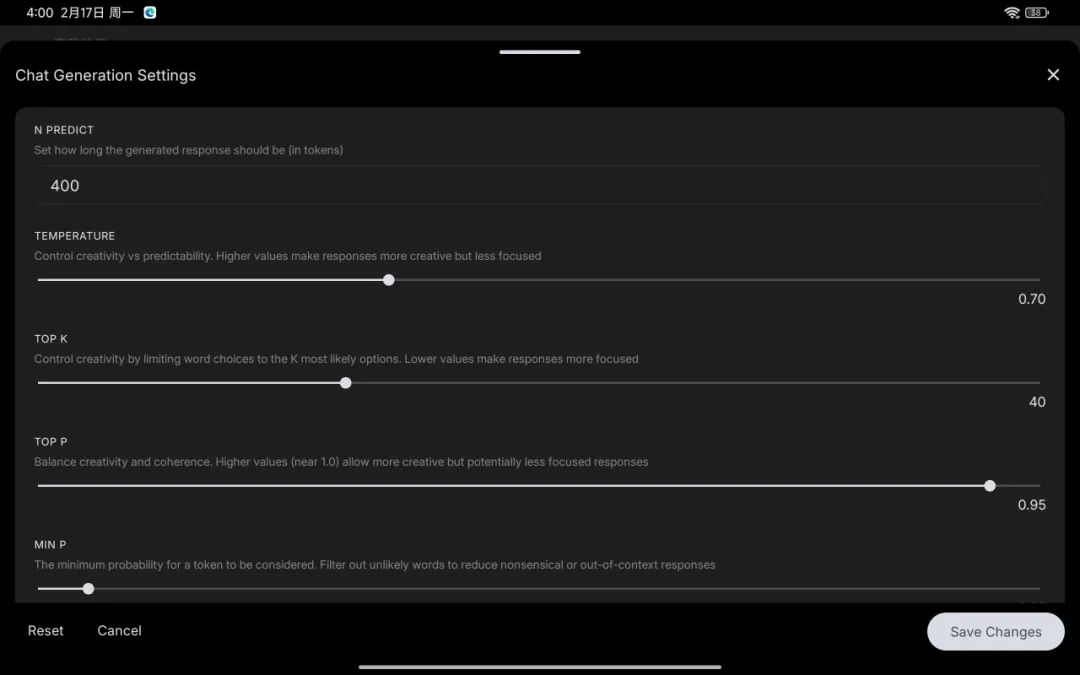

另外在聊天生成设置功能方面,可以对上下文设置,用户可设置生成内容的最大长度,默认建议调整为 4096 或 8000,支持选择不同预置模板,实时性能指标等。

另外由于Hugging Face是国外平台,有可能在线下载时,由于网络问题下载不了,PocketPal AI也提供了本地模型加载方式,可以通过本地加载 GGUF 格式模型,点击 + 本地加载模型(Add Local Model)- 选择你下载好的模型 - 模型管理 - 点击 Load 启动。

我已经打包好了DeepSeek-R1的所有版本,直接进网盘下载会更快: https://pan.quark.cn/s/368117b904ff